Über das französische Start-up Mistral AI als Alternative zu den bekannten proprietären Closed KI-Modellen der amerikanischen Tech-Konzerne habe ich schon mehrfach geschrieben (Beiträge). Erstaunlich dabei ist, dass Mistral AI mit seinen Modellen in der Zwischenzeit durchaus wettbewerbsfähig ist. Siehe dazu Open Source AI holt auf – das Beispiel MISTRAL AI (AI Report 2026). Wer die Mistral-KI-Modelle nicht über die Mistral-Cloud nutzen möchte, kann in der Zwischenzeit auch eine entsprechende App auf dem eigenen Laptop installieren (Blogbeitrag).

Besonders überzeugt hat uns auch der von Mistral AI veröffentlichte Chatbot mit dem Namen „Le Chat“, den wir schon ausgiebig genutzt haben. Zunächst in der freien Version (ohne Anmeldung) und später mit einem Login-Zugang. Dort können wir Chats speichern und Projekte sowie Workflows und Agenten anlegen.

Nun hat Mistral den Chatbot „Le Chat“ in „Vibes“ integriert – der Name „Vibes“ war zunächst für Agentic Coding gedacht, Die Einbindung des Chatbots „Le Chat“ in „Vibes“ bietet dadurch neue Möglichkeiten.

„Mistral hat auf dem hauseigenen AI Now Summit mehrere Neuerungen vorgestellt. Der Chatbot Le Chat heißt jetzt Vibe und verbindet agentische Fähigkeiten mit Funktionen für Softwareentwicklung“(heise online, 29.05.2026).

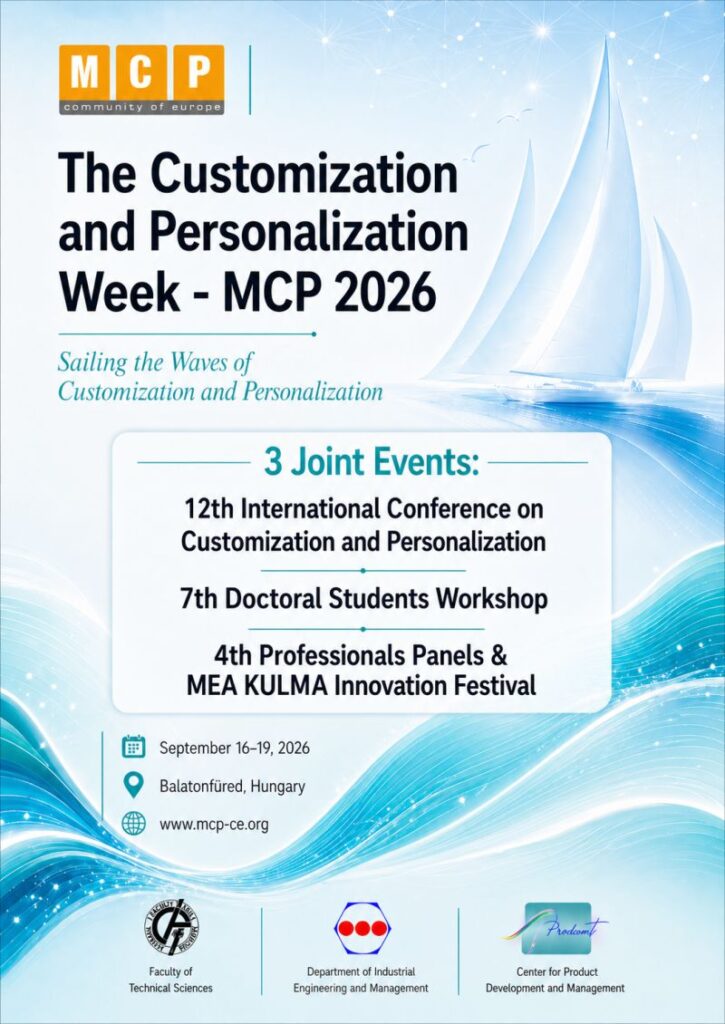

Auf der internationalen Konferenz MCP 2026, die vom 16.-19.09.2026 in Balatonfüred, (Ungarn) stattfindet, werde ich in meinen beiden Papern auch auf Mistral AI eingehen:

Digital Sovereignty and Open-Source AI: The European Way for Innovative SMEs

Open-Source AI for Open User Innovation: Designing a Personal Fabrication Framework